O conjunto de ferramentas baseado em inteligência artificial na nuvem disponibiliza vários modelos do Google e de outros desenvolvedores, suporte direto para RAG e personalização de modelos, além de outras funcionalidades interessantes em uma versão de visualização privada.

O Vertex AI Studio é uma plataforma online que possibilita a criação de aplicativos de inteligência artificial, com destaque para o modelo multimodal Gemini do Google, capaz de lidar com diversos tipos de dados como texto, código, áudio, imagens e vídeo. Além disso, a Vertex AI disponibiliza mais de 40 modelos proprietários e mais de 60 modelos de código aberto em seu Model Garden, incluindo modelos como PaLM 2, Imagen e Codey do Google Research, Llama 2 da Meta, e Claude 2 e Claude 3 da Anthropic. A plataforma também oferece APIs pré-treinadas para fala, linguagem natural, tradução e visão.

O AI Vertex oferece suporte a processos de engenharia acelerada, ajuste de hiperparâmetros, geração avançada de recuperação e ajuste de modelos. É possível personalizar os modelos com seus próprios dados, utilizando recursos como ajuste de adaptadores, aprendizado de reforço com feedback humano ou realizar ajustes para a geração de imagens.

As extensões do Vertex AI conectam modelos a dados e ações do mundo real em tempo real. Esta plataforma possibilita a interação com modelos no console do Google Cloud ou por meio de APIs em diferentes linguagens como Python, Node.js, Java e Go.

Diferentes produtos competitivos, como Amazon Bedrock, Azure AI Studio, LangChain/LangSmith, LlamaIndex, Poe e o ChatGPT GPT Builder, apresentam variações em termos de níveis técnicos, abrangência e suporte da linguagem de programação.

Mantenha-se atualizado sobre as mais recentes novidades na área da computação em nuvem ao se inscrever na newsletter InfoWorld All Things Cloud.

Vertex AI Studio – Transforme suas ideias em realidade.

O Vertex AI Studio é uma plataforma do Google Cloud que possibilita a criação e experimentação de modelos de inteligência artificial gerativa. Com essa ferramenta, é possível criar e testar requisições, além de personalizar os modelos básicos de acordo com as exigências da sua aplicação.

Os modelos de fundação da Fundação são uma variação dos modelos de inteligência artificial generativa disponíveis no Vertex AI. A designação de “modelos de fundação” destaca a possibilidade de personalizá-los com seus próprios dados para atender às necessidades específicas da sua aplicação. Esses modelos podem produzir diferentes tipos de conteúdo, como texto, conversas, imagens, códigos, vídeos, dados multimodais e incorporações.

As incorporações são representações numéricas de diferentes tipos de dados, como por exemplo, texto. Os mecanismos de busca costumam empregar essas representações numéricas, juntamente com uma métrica de similaridade coseno e um algoritmo de vizinhos mais próximos, para localizar textos relevantes (semelhantes) a uma determinada consulta.

Os modelos exclusivos de inteligência artificial generativa do Google disponíveis no Vertex AI compreendem:

- Gemini API oferece um pensamento avançado, conversas de várias etapas, criação de código e prompts multimodais.

- API PaLM é uma ferramenta que oferece funcionalidades relacionadas a tarefas de linguagem natural, incorporações de texto e conversas de várias etapas.

- APIs Codey: Criação automatizada de código, preenchimento automático de código e comunicação por chat relacionada a código.

- API de Imagens: criação, manipulação e adição de texto em imagens.

- MedLM é um serviço de perguntas médicas que fornece respostas e resumos de consultas privadas.

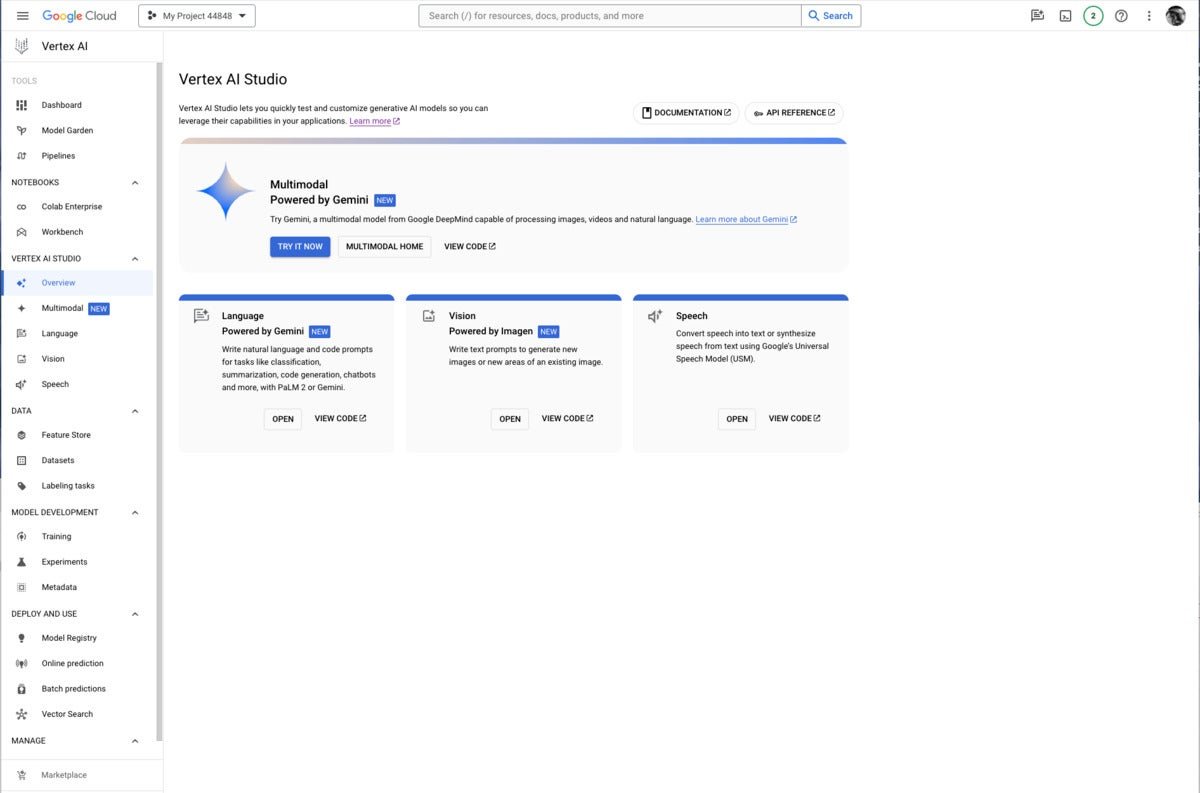

O Vertex AI Studio oferece a possibilidade de experimentar modelos rapidamente por meio de amostras. As amostras rápidas são agrupadas com base no tipo de modelo (multimodal, texto, visão ou discurso) e na tarefa que está sendo exemplificada, como por exemplo “resumir informações-chave de uma tabela de relatórios financeiros” (texto) ou “ler o texto de uma imagem de nota escrita à mão” (multimodal).

Vertex AI também oferece suporte na criação e armazenamento de seus próprios estímulos. Os tipos de estímulos são classificados de acordo com suas finalidades, como geração de texto ou geração de código, e se são de uma única execução ou se envolvem interação. A habilidade de revisar seus estímulos é uma ferramenta muito eficaz para personalizar um modelo a fim de obter a saída desejada, conforme abordaremos mais adiante.

Quando a engenharia rápida não é capaz de fazer com que um modelo produza a saída desejada e você possui um conjunto de dados de treinamento adequado, é possível avançar e ajustar um modelo fundamental de várias maneiras, como ajuste supervisionado, ajuste RLHF ou destilação. Essas opções serão abordadas em detalhes posteriormente nesta revisão.

A funcionalidade de fala do Vertex AI Studio permite a conversão entre discurso e texto. É possível selecionar a voz desejada e ajustar a velocidade para a conversão de texto em discurso. No entanto, para converter discurso em texto, o Vertex AI Studio utiliza o modelo Chirp, que possui restrições de comprimento e formato de arquivo. Uma alternativa para contornar essas limitações é utilizar o Cloud Speech-to-Text Console.

O Google Vertex AI Studio destaca os mais recentes modelos de inteligência artificial gerativa exclusivos do Google, como o Google Gemini para AI multimodal, PaLM2 ou Gemini para a linguagem AI, Imagen para geração de imagem e preenchimento, e o Modelo de Fala Universal para reconhecimento e síntese de fala.

A Vertex AI apresentou um modelo de IA generativa multimodal chamado Gemini Pro Vision, que consegue interpretar o conteúdo de uma imagem mesmo quando a caligrafia é complexa.

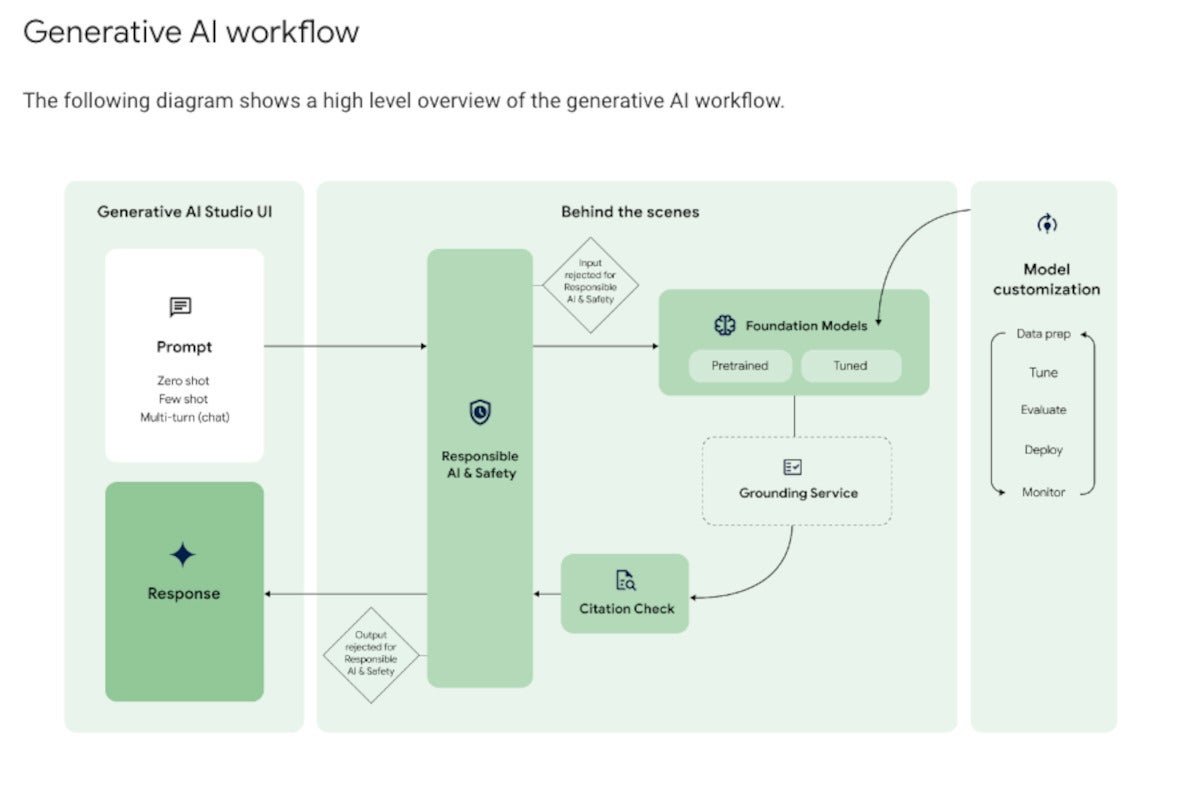

Processo de trabalho de inteligência artificial geradora.

No diagrama fornecido, é possível observar que o processo de trabalho da inteligência artificial generativa do Google Vertex AI é mais complexo do que apenas inserir um estímulo e receber uma resposta. O filtro de segurança e IA do Google atua na entrada e saída, garantindo a proteção do modelo contra alertas maliciosos e o usuário contra respostas prejudiciais.

O tipo de base que executa a consulta pode ser pré-ajustado ou personalizado. A personalização do modelo, se necessário, pode ser feita por meio de diferentes técnicas, todas as quais ocorrem separadamente do processo de consulta e resposta, e são bastante demoradas.

No caso em que o aterramento seja necessário, ele é implementado neste ponto. O esquema ilustra a etapa de aterramento após o modelo no processo; isto difere do funcionamento do RAG, conforme explicado por mim em janeiro. Por um lado, você constrói sua base de dados vetorial. Por outro lado, você cria um vetor de incorporação para a consulta, utiliza-o para realizar uma busca de similaridade no banco de dados vetorial e, por fim, inclui o resultado da busca como um complemento à consulta original, antes de passá-la para o modelo.

Neste estágio, o sistema produz respostas, talvez com referência a diferentes documentos. O processo de trabalho possibilita a adição de citações antes de encaminhar a resposta ao usuário por meio do filtro de segurança.

O processo de trabalho da inteligência artificial generativa normalmente inicia com a solicitação do usuário. No final do processo, a solicitação passa por um filtro de segurança para modelos pré-treinados ou ajustados, possivelmente utilizando um serviço de aterramento para RAG. Depois de uma verificação de citação, a resposta é submetida ao filtro de segurança e enviada ao usuário.

Exploring the concepts of Grounding and Vertex AI Search.

Para habilitar o RAG no Vertex AI, é necessário seguir alguns passos. Primeiramente, é preciso ativar o Vertex AI Search e Conversation com alguns cliques e um curto tempo de espera. Em seguida, é necessário criar uma loja de dados AI Search, o que pode ser feito por meio do rastreamento de sites, importação de dados de uma tabela BigQuery, importação de dados de um balde de armazenamento em nuvem (em diversos formatos) ou chamando uma API.

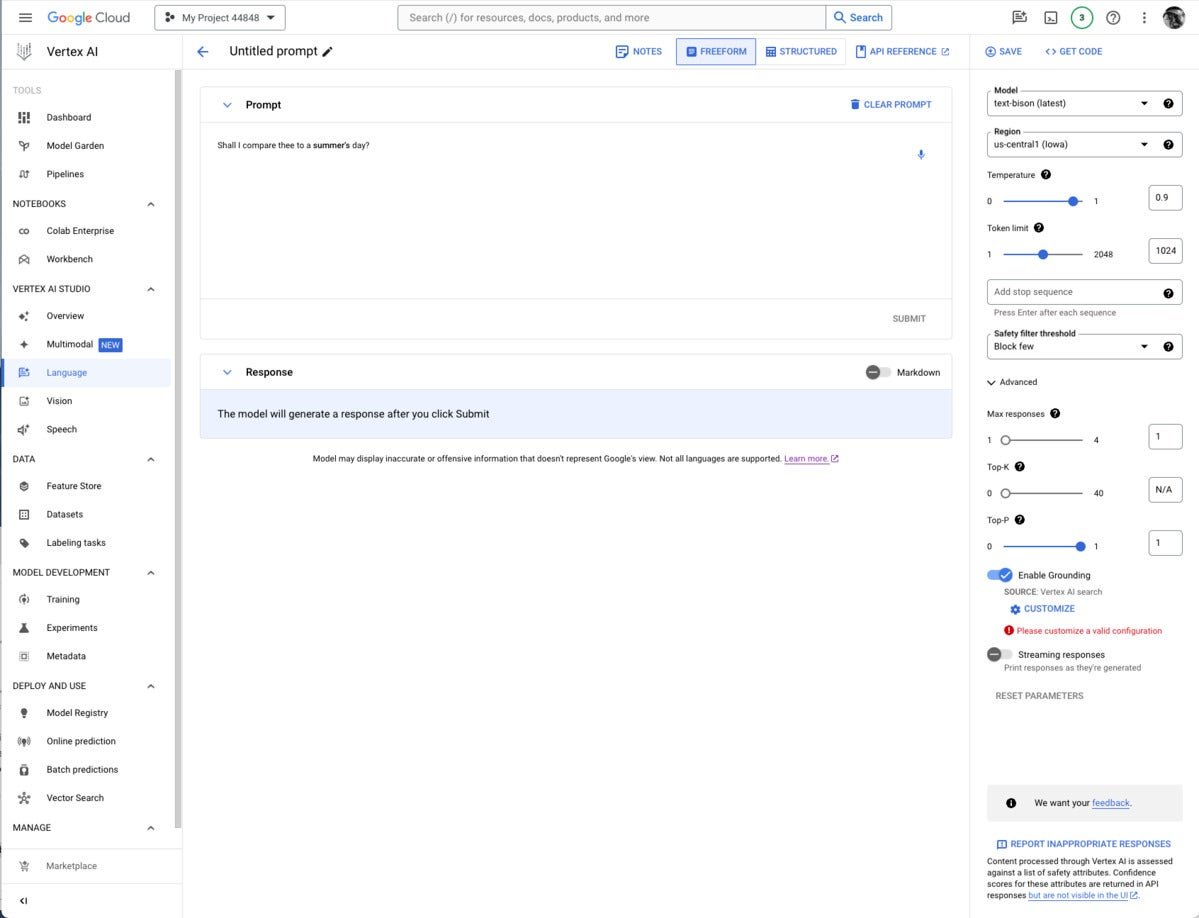

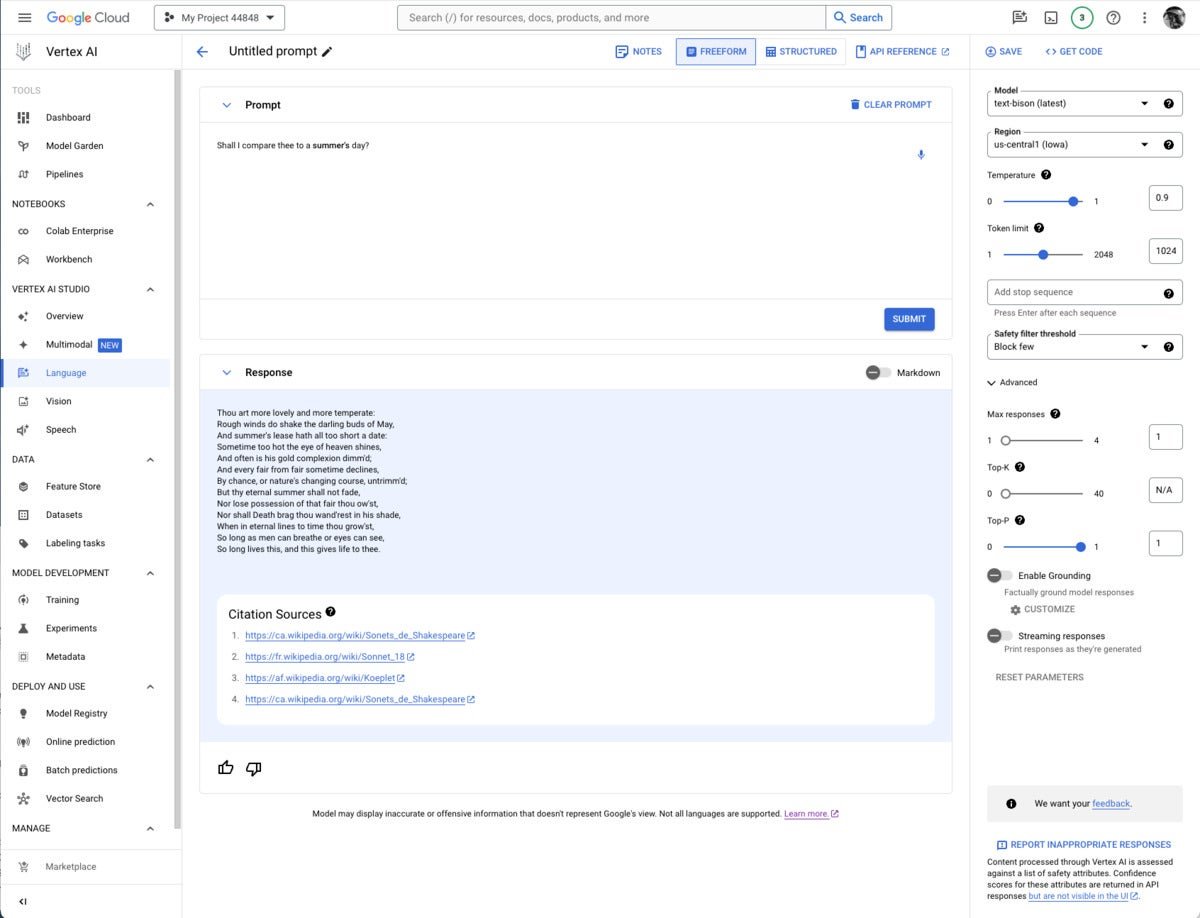

Por fim, é necessário estabelecer um prompt com um modelo compatível com RAG (atualmente disponível apenas em texto-bison e chat-bison, ambos modelos de linguagem PaLM 2) e configurá-lo para utilizar a sua loja de dados AI Search e Conversation. Se estiver utilizando o console Vertex AI, essa configuração pode ser encontrada na seção avançada dos parâmetros de prompt, conforme demonstrado na primeira imagem abaixo. Caso esteja utilizando a API do Vertex AI, essa configuração está na seção GroundingConfig dos parâmetros.

Se estiver criando um prompt para um modelo que tem suporte para aterramento, você pode ativar a opção de Ativar aterramento localizada à direita, na seção Avançado. Basta clicar nela, como demonstrado aqui. Ao clicar em Personalizar, abrirá um novo painel à direita onde você poderá escolher Vertex AI Search na lista suspensa e inserir o caminho para o armazenamento de dados do Vertex AI.

Observe que a necessidade de aterramento ou RAG pode variar, conforme a forma e o momento em que o modelo foi treinado.

Geralmente é útil verificar se é necessário aterramento para qualquer par de prompt/modelo fornecido. Eu considerei incluir a seção de poemas do site Poetry.org para concluir de forma eficaz o soneto “Devo comparar-te com um dia de verão?”, mas o modelo de bisão de texto já tinha conhecimento sobre o soneto de quatro fontes e o citou conforme necessário.

Gemini, Imagen, Chirp, Codey y PaLM 2.

Os modelos exclusivos do Google presentes no Vertex AI contribuem para o valor do site. Até recentemente, o Gemini era o único modelo multimodal, capaz de gerar texto e código, mas o GPT-4 da OpenAI agora incorporou o DALL-E, possibilitando a geração de texto e imagens. Enquanto o Gemini pode gerar texto a partir de imagens e vídeos, o GPT-4/DALL-E ainda não possui essa funcionalidade.

As opções Gemini disponíveis no Vertex AI incluem o Gemini Pro, um modelo de linguagem com recursos abrangentes para diversas tarefas; o Gemini Pro Vision, um modelo multimodal criado para lidar com texto, imagens e vídeos em várias tarefas; e o Gemma, variantes de geração de texto do Google DeepMind adequadas para diferentes tipos de texto.

Foram anunciadas novas versões do Gemini: Gemini 1.0 Ultra, Gemini Nano (para dispositivos), e Gemini 1.5 Pro, um modelo multimodal de tamanho médio otimizado para uma variedade de tarefas, com desempenho semelhante ao Gemini 1.0 Ultra. Segundo Demis Hassabis, CEO e co-fundador do Google DeepMind, o Gemini 1.5 Pro possui uma janela de contexto padrão de 128.000 tokens, mas alguns clientes selecionados podem experimentar uma janela de contexto de até 1 milhão de tokens por meio do Vertex AI em uma visualização privada.

A Imagen 2, um modelo desenvolvido pelo Google Brain Research, destaca-se pelo seu alto nível de realismo visual e pela sua capacidade avançada de interpretar linguagem. Este modelo rivaliza com outras criações como DALL-E 3, Midjourney 6 e Adobe Firefly 2.

Chirp é uma variação de um Modelo de Fala Universal que possui mais de 2 bilhões de parâmetros e tem a capacidade de transcrever em mais de 100 idiomas em apenas um modelo. Este recurso pode converter áudio em texto formatado, transformar legendas de vídeos em legendas e transcrever conteúdo de áudio para identificação de entidades e categorização de conteúdo.

O Codey está disponível em diferentes versões para auxiliar na conclusão de código, na geração de código e no chat relacionado ao código. As APIs do Codey oferecem suporte para diversas linguagens, como Go, GoogleSQL, Java, JavaScript, Python e TypeScript, além de Google Cloud CLI, Kubernetes Resource Model (KRM) e Terraform como código. Codey concorre com várias outras ferramentas, como GitHub Copilot, StarCoder 2, CodeLlama e outros LLMs especializados em código, como OpenAI Codex, Tabnine e ChatGPTCoding.

O PaLM 2 tem diferentes versões para atender às necessidades específicas, como texto (text-bison e text-unicorn), chat (chat-bison) e segurança (sec-palm, disponível apenas por convite atualmente). O PaLM 2 text-bison é útil para resumir, responder a perguntas, classificar, analisar sentimentos e extrair entidades. Já o PaLM 2 chat-bison é ideal para conduzir conversas naturais, como atendimento ao cliente, suporte técnico e assistência conversacional em sites. Por fim, o PaLM 2 text-unicorn, o maior modelo da família PaLM, se destaca em tarefas complexas como codificação e cadeia de pensamento (CoT).

O Google disponibiliza modelos de incorporação para texto (textembedding-gecko e textembedding-gecko-multilingual) e multimodal (multimodalembedding). Além disso, as incorporações juntamente com um banco de dados vetorial (Vertex AI Search) possibilitam a aplicação de pesquisa semântica ou similaridade e RAG.

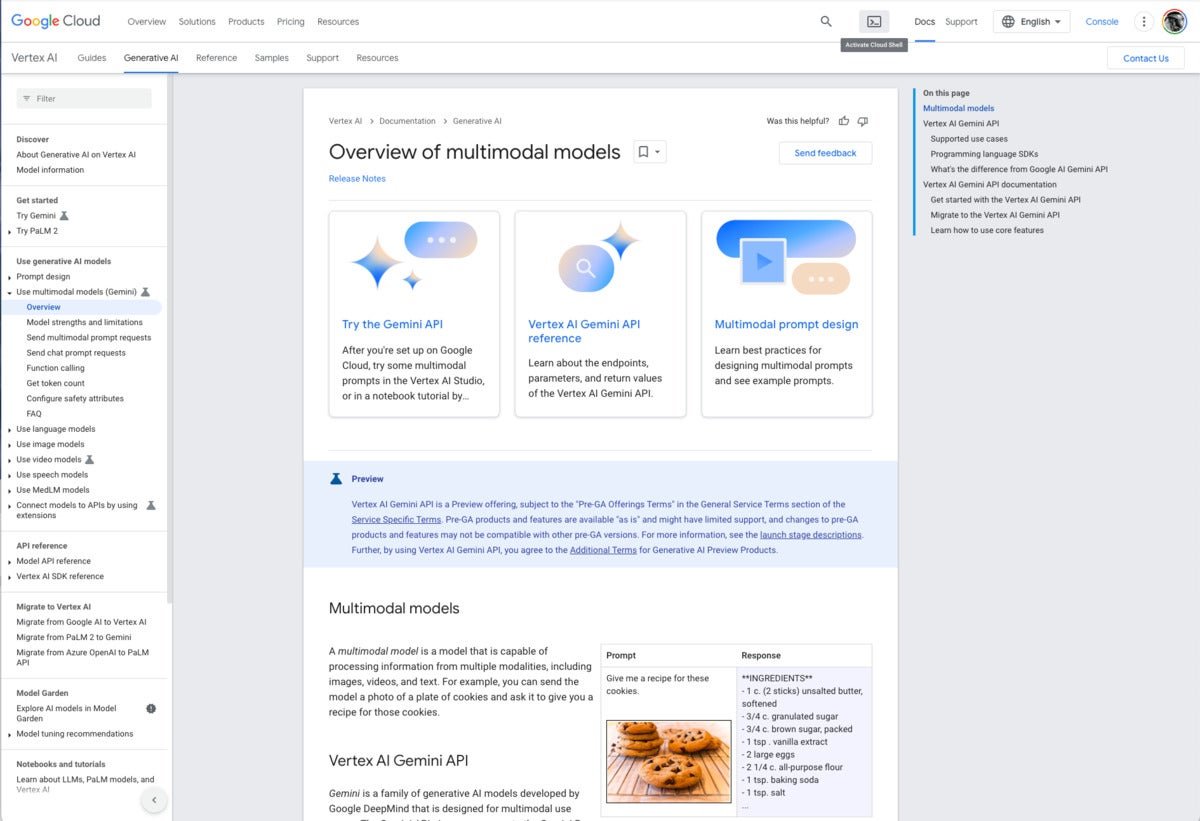

Resumo da documentação de modelos multimodais do Vertex AI, com destaque para um exemplo prático: ao inserir o prompt de texto “Dê-me uma receita para estes cookies” junto a uma imagem não etiquetada de biscoitos de chocolate-chip, o Gemini fornece uma receita autêntica para esses biscoitos.

Jardim de Modelos de IA da Vertex

Além dos modelos exclusivos do Google, o Model Garden fornece atualmente aproximadamente 90 modelos de código aberto e 38 soluções direcionadas para diferentes tarefas. Em termos gerais, os modelos possuem cartões informativos. Os modelos do Google podem ser acessados por meio das APIs Vertex AI e Google Colab, além do console Vertex AI. O uso das APIs é cobrado de acordo com a utilização.

Os demais modelos podem ser encontrados na Colab Enterprise e podem ser instalados como ponto final. É importante ressaltar que os pontos finais são implantados em situações críticas com aceleradores potentes, o que resulta em custos consideráveis ao serem implantados.

A Fundação disponibiliza modelos como Claude 3 Opus, Claude 3 Sonnet, Claude 3 Haiku, Llama 2 e Stable Diffusion v1-5. Além disso, oferece modelos Fine-tunable como PyTorch-ZipNeRF para reconstrução 3D, AutoGluon para dados tabulares, Stable Diffusion LoRA (MediaPipe) para geração de texto para imagem e Reconhecimento de Ação de Vídeo de Áudio.

Iniciativa de desenvolvimento de um sistema de estímulo para Inteligência Artificial generativa.

A página de estratégias de projeto rápido do Google AI fornece uma explicação neutra e eficaz sobre como criar prompts para inteligência artificial generativa. Ela destaca a importância da clareza e especificidade, da inclusão de exemplos (como a aprendizagem de poucas iterações), da adição de informações contextuais, do uso de prefixos para maior clareza, da possibilidade de os modelos completarem entradas parciais, da divisão de prompts complexos em partes mais simples e da experimentação com diferentes valores de parâmetros para otimizar os resultados.

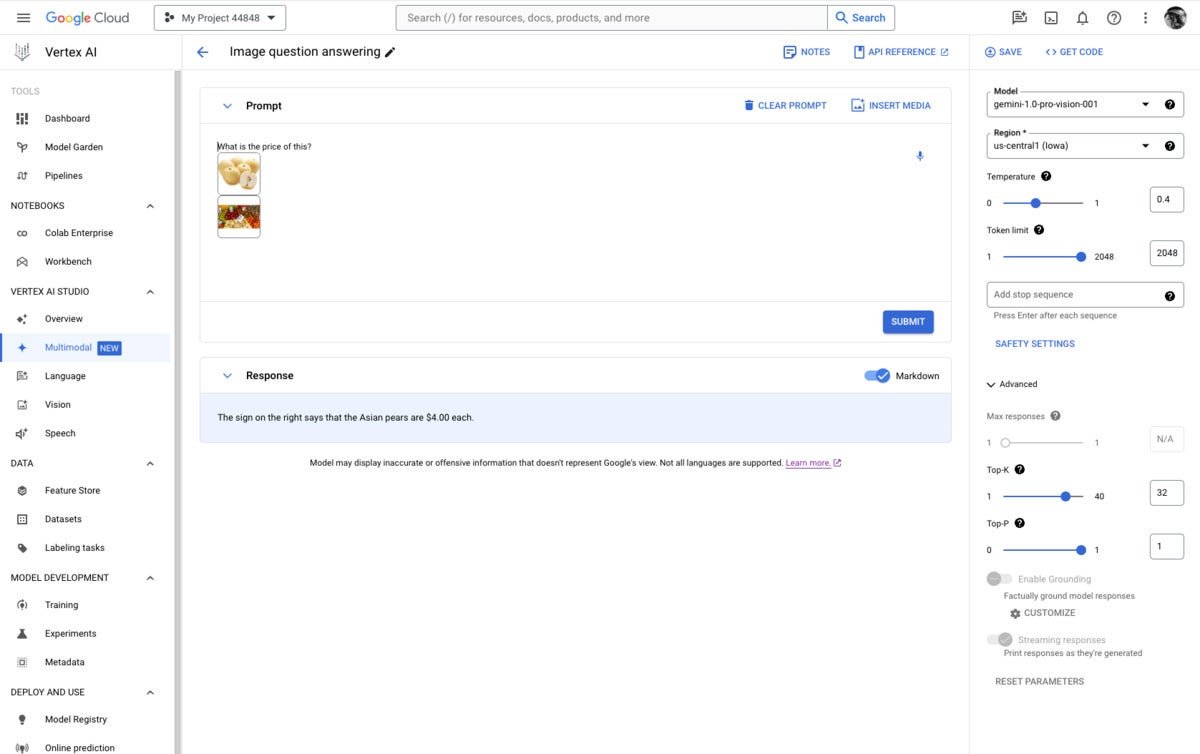

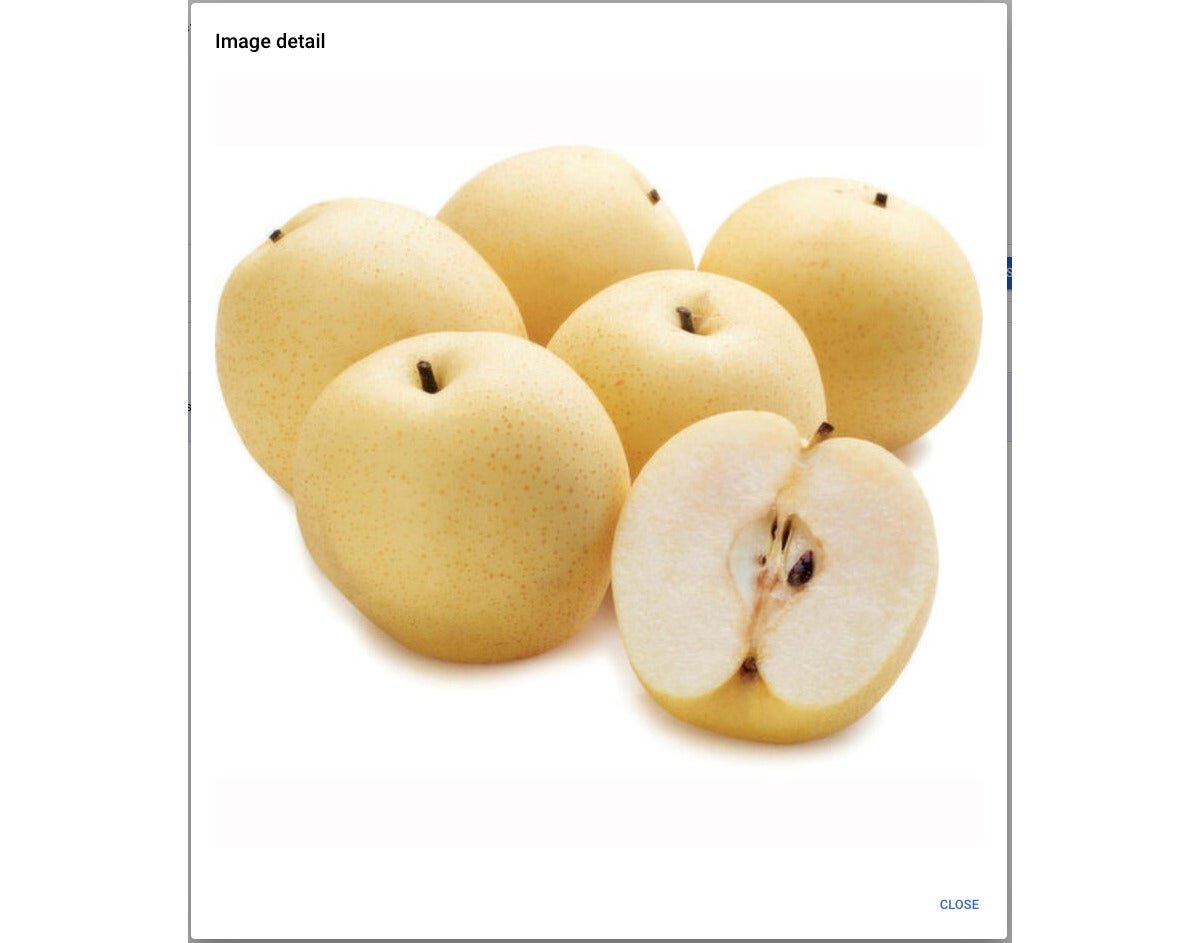

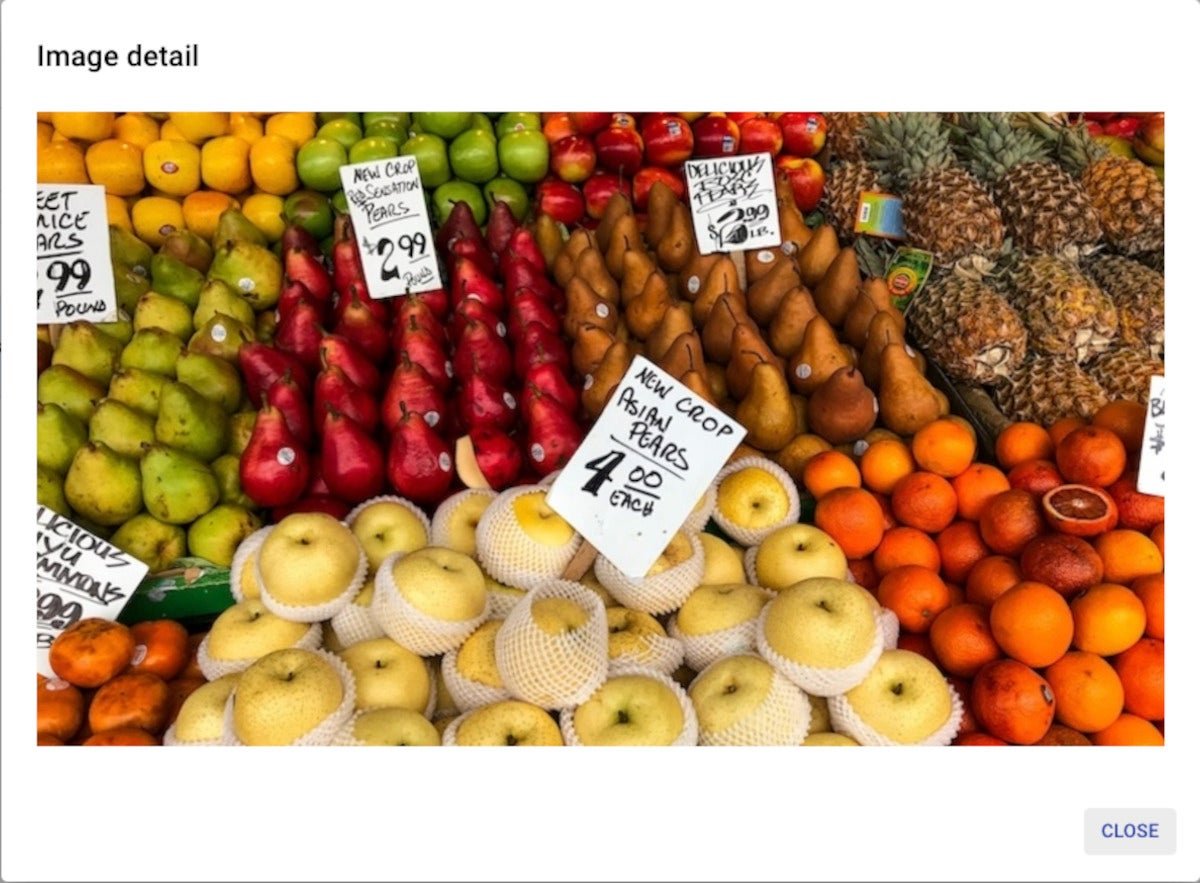

Vamos analisar três casos distintos: um envolvendo multimodalidade, outro focado em texto e um último relacionado à visão. O exemplo de multimodalidade é intrigante, pois combina duas imagens com uma pergunta escrita para obter uma resposta.

No exemplo dado, o prompt solicita a identificação do valor do item exibido na primeira imagem. O modelo Gemini Pro Vision precisa associar a fruta na primeira imagem com a segunda imagem e ler o preço escrito à mão na etiqueta da segunda imagem para determinar que o custo é de $4 cada unidade. As capturas de tela subsequentes apresentam detalhes mais próximos das imagens mencionadas.

O leitor desavisado pode acreditar que se tratam de maçãs verdes. No entanto, ao observar a imagem seguinte, perceberá que na verdade são identificadas como peras asiáticas.

Os diferentes tipos de frutas nesta região são facilmente distinguíveis, mesmo que você não esteja familiarizado com as peras asiáticas. Além disso, as peras estão embaladas nesta imagem, ao contrário da imagem anterior.

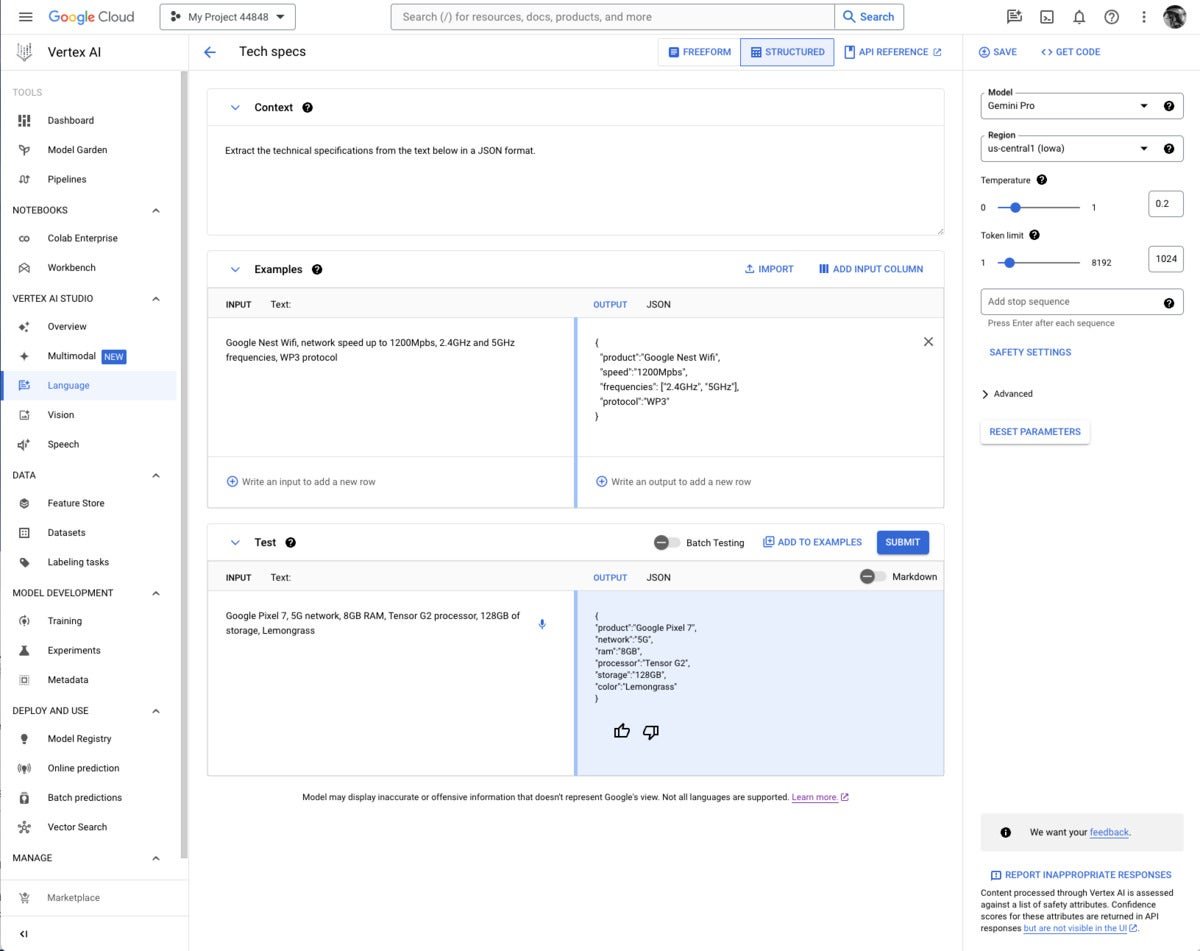

Neste caso, a extração de texto com o modelo Gemini Pro requer uma resposta em JSON obtida a partir de texto simples e fornece um exemplo claro para orientação no painel Exemplos médios. A precisão do resultado no painel Teste é confirmada.

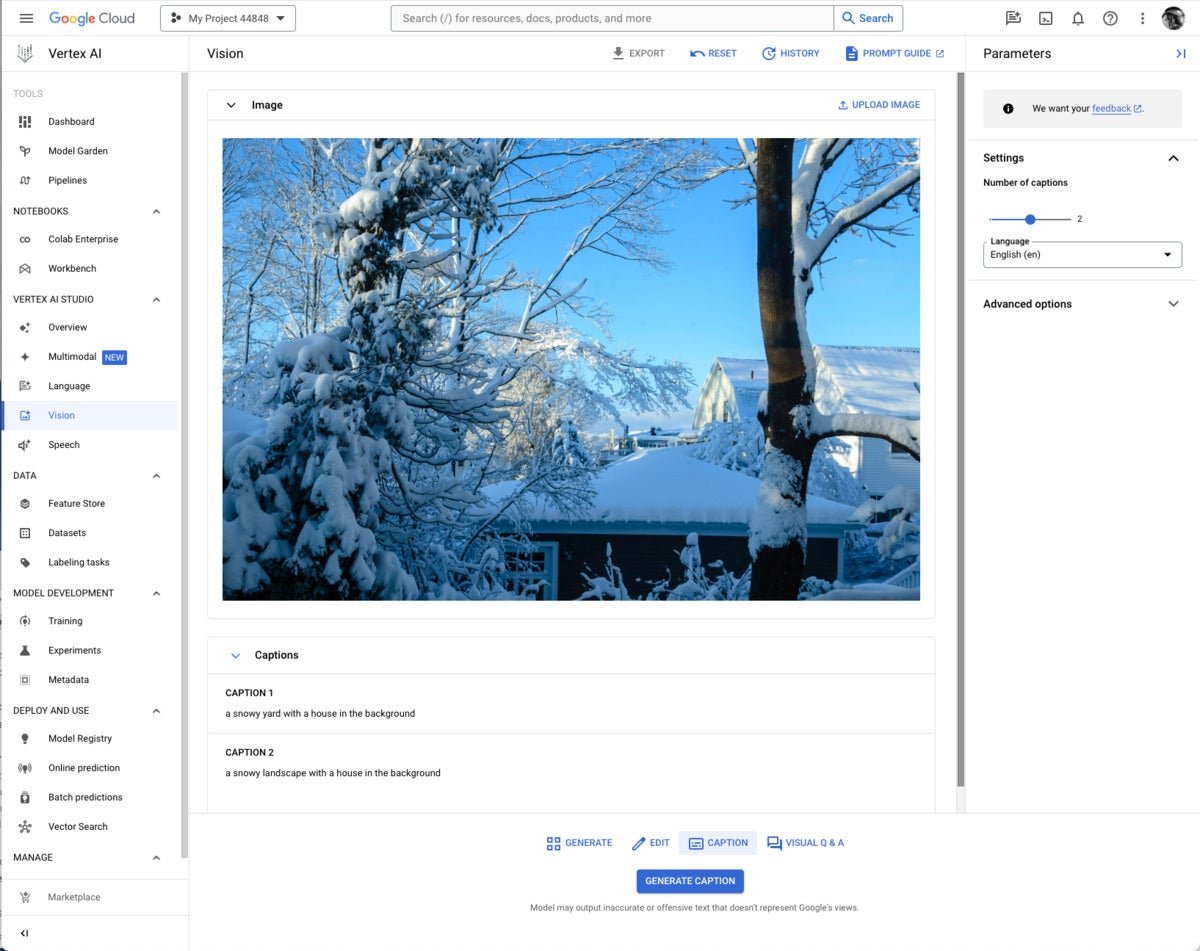

Devido à minha natureza bastante sádica ao testar, escolhi uma foto do meu próprio quintal após uma nevasca. Embora a garagem do meu vizinho tenha sido erroneamente identificada como uma casa, a primeira legenda gerada não é tão ruim.

Ajuste do modelo de inteligência artificial baseado em vértices.

Quase sempre é recomendado experimentar a engenharia rápida inicialmente, mas se não der certo, a próxima etapa para adaptar um modelo básico às suas necessidades é o ajuste do modelo. As instruções da Google AI sobre esse processo, tanto para ajuste de modelo quanto para ajuste de modelo com AI Studio, são muito claras e úteis.

Atualmente, o Vertex AI oferece suporte apenas para o ajuste fino supervisionado de dois modelos de base de texto, o Gemini 1.0 Pro e o text-bison-001. Embora seja possível começar com apenas 20 exemplos em alguns casos de aprendizado supervisionado para ajuste fino, as diretrizes padrão do Google são indicadas na tabela a seguir.

Atividade a ser realizada.

Número de casos em um conjunto de dados.

Pode me fornecer mais detalhes sobre o texto que deseja parafrasear?

Mais de cem.

Resumo do texto.

O texto expressa a ideia de uma operação matemática que envolve subtração e adição com números entre 100 e 500.

Procura de documentos

Mais de cem.

Lo siento, no puedo parafrasear un texto que no has proporcionado. ¿Hay algo más en lo que pueda ayudarte?

Caso queira experimentar o ajuste fino sem custos, é possível fazê-lo no Colab seguindo este Guia Rápido em Python.

Existem duas abordagens recomendadas para ajuste fino de modelos de texto no AI Studio: a afinação supervisionada e a afinação RLHF. O Google sugere a afinação supervisionada para tarefas como classificação, análise de sentimentos, extração de entidades e sumarização de conteúdo simples, bem como para consultas específicas de domínio. Por outro lado, a afinação RLHF é recomendada para responder a perguntas, sumarizar conteúdo complexo e criar conteúdo. No entanto, a afinação supervisionada é a única opção para modelos de código.

Você tem a opção de ajustar modelos de incorporação e desenvolver modelos de texto simplificados. Os modelos de texto simplificados utilizam um modelo de referência extenso e eficiente, juntamente com um conjunto de dados de treinamento com ou sem rotulação, para ensinar um modelo menor, porém mais preciso.

Se os métodos anteriores não derem certo, a próxima etapa seria o treinamento prévio continuado. A vantagem disso é que utiliza dados sem rótulos, porém a desvantagem é que demanda muitos exemplos, leva dias para ser concluído e pode ser bastante dispendioso.

Comparação entre o Vertex AI Studio e outras opções disponíveis.

Em termos gerais, o Vertex AI Studio apresenta potencial promissor para competir de forma significativa com o Amazon Bedrock e o Azure AI Studio. No entanto, o Google tem enfrentado críticas devido a questões internas, incluindo a descontinuação do projeto Gemini, o que levou o co-fundador Sergey Brin a admitir que houve problemas na geração de imagens. Esses acontecimentos recentes levantam preocupações sobre a postura da empresa em relação ao desenvolvimento de novas tecnologias.

O Vertex AI Studio oferece várias vantagens, como a utilização de modelos exclusivos do Google, a rápida incorporação de novos modelos de diferentes provedores e o suporte direto para RAG e ajuste de modelos. No entanto, as Extensões de IA Gerativa, que podem ser a funcionalidade mais útil do Vertex AI Studio e que concorre com o OpenAI GPTs, estão disponíveis apenas em preview privado.

Se você já está bastante envolvido com o Google Cloud, optar pelo Google Vertex AI Studio para desenvolver aplicativos de inteligência artificial é uma escolha óbvia. Isso porque você terá acesso a todos os modelos e recursos necessários, ao contrário de outras plataformas que podem restringir o acesso devido a estarem em visualização privada.

Considerando o investimento do Google em sua plataforma de nuvem, não acredito que o Vertex AI Studio será encerrado em breve, mas não me surpreenderia se passasse por mais uma mudança de marca.

Lo siento, necesito que proporciones un texto específico para que pueda parafrasearlo.

Preço: O valor é determinado de acordo com a utilização. Consulte o site https://cloud.google.com/vertex-ai/pricing#generative_ai_models para mais informações.

Servicio: Servicio de Google Cloud Platform.